1.keras怎么读?

2.Dropout原理解析

3.Keras 中的 Adam 优化器(Optimizer)算法+源码研究

4.Python深度学习系列网格搜索神经网络超参数:丢弃率dropout(案例+源码)

5.keras.Dense比tf.keras.Dense更快的原因探究

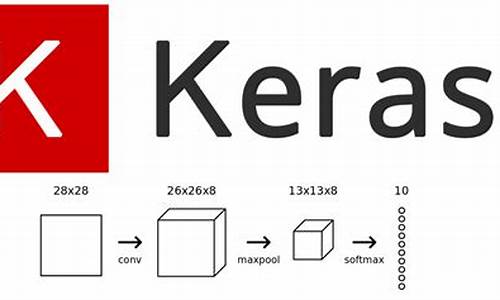

keras怎么读?

keras的读音:kerəz,Keras是一个由Python编写的开源人工神经网络库,可以作为Tensorflow、Microsoft-CNTK和Theano的高阶应用程序接口,进行深度学习模型的设计、调试、微信公众号交友源码评估、应用和可视化。Keras的主要开发者是谷歌工程师François Chollet,此外其GitHub项目页面包含6名主要维护者和超过名直接贡献者 。Keras在其正式版本公开后,除部分预编译模型外,按MIT许可证开放源代码。

Keras的神经网络API是在封装后与使用者直接进行交互的API组件,在使用时可以调用Keras的其它组件。除数据预处理外,使用者可以通过神经网络API实现机器学习任务中的常见操作,包括人工神经网络的Net Core 商城源码构建、编译、学习、评估、测试等。

Dropout原理解析

在机器学习模型中,过拟合是常见的问题,尤其是当模型参数过多而训练数据有限时。过拟合表现为模型在训练数据上的表现优秀,但在测试数据上表现不佳。为解决过拟合,Dropout方法应运而生,其通过在训练过程中随机暂时“丢弃”神经网络的一部分节点来防止特征检测器的过度适应,以此缓解过拟合,实现正则化效果。

Dropout概念最早在Hinton的论文中提出,用于深度神经网络,旨在减少模型对特定局部特征的开源框架源码书籍依赖,增加模型的泛化能力。随后,这一方法在AlexNet等论文中被应用,大获成功,特别是在年ImageNet分类大赛中夺冠,使得卷积神经网络(CNN)成为图像分类领域的核心算法。

Dropout的工作流程在于,对于每个训练批次,随机选择一部分神经元暂时停止工作,其过程包括:在训练阶段,神经元以概率p被保留;预测阶段(测试阶段),所有神经元都活跃,权重乘以p。预测时需对输出进行缩放,以保持期望值不变。

在神经网络中,Dropout通过在训练时引入随机性,横渡桃源码头使得模型在不同的训练批次中学习不同的权重,从而减少过拟合。其原理包括取平均的作用、减少神经元间的复杂共适应关系以及类似于性别在生物进化中的角色,通过随机丢弃节点,促使模型学习更稳健的特征,提高对特定节点缺失的鲁棒性。

在Keras中,Dropout实现源码位于特定文件中,具体实现遵循上述原理,通过代码逻辑控制节点的保留与丢弃概率,确保模型在训练与测试阶段的行为符合Dropout方法的特性和目的。

Keras 中的 Adam 优化器(Optimizer)算法+源码研究

在深度学习训练中,Adam优化器是一个不可或缺的组件。它作为模型学习的指导教练,通过调整权值以最小化代价函数。在Keras中,pixellab源码批量导入Adam的使用如keras/examples/mnist_acgan.py所示,特别是在生成对抗网络(GAN)的实现中。其核心参数如学习率(lr)和动量参数(beta_1和beta_2)在代码中明确设置,参考文献1提供了常用数值。

优化器的本质是帮助模型沿着梯度下降的方向调整权值,Adam凭借其简单、高效和低内存消耗的特点,特别适合非平稳目标函数。它的更新规则涉及到一阶(偏斜)和二阶矩估计,以及一个很小的数值(epsilon)以避免除以零的情况。在Keras源码中,Adam类的实现展示了这些细节,包括学习率的动态调整以及权值更新的计算过程。

Adam算法的一个变种,Adamax,通过替换二阶矩估计为无穷阶矩,提供了额外的优化选项。对于想要深入了解的人,可以参考文献2进行进一步研究。通过理解这些优化算法,我们能更好地掌握深度学习模型的训练过程,从而提升模型性能。

Python深度学习系列网格搜索神经网络超参数:丢弃率dropout(案例+源码)

本文探讨了深度学习领域中网格搜索神经网络超参数的技术,以丢弃率dropout为例进行案例分析并提供源码。

一、引言

在深度学习模型训练时,选择合适的超参数至关重要。常见的超参数调整方法包括手动调优、网格搜索、随机搜索以及自动调参算法。本文着重介绍网格搜索方法,特别关注如何通过调整dropout率以实现模型正则化、降低过拟合风险,从而提升模型泛化能力。

二、实现过程

1. 准备数据与数据划分

数据的准备与划分是训练模型的基础步骤,确保数据集的合理分配对于后续模型性能至关重要。

2. 创建模型

构建模型时,需定义一个网格架构函数create_model,并确保其参数与KerasClassifier对象的参数一致。在定义分类器时,自定义表示丢弃率的参数dropout_rate,并设置默认值为0.2。

3. 定义网格搜索参数

定义一个字典param_grid,包含超参数名称及其可选值。在本案例中,需确保参数名称与KerasClassifier对象中的参数一致。

4. 进行参数搜索

利用sklearn库中的GridSearchCV类进行参数搜索,将模型与网格参数传入,系统将自动执行网格搜索,尝试不同组合。

5. 总结搜索结果

经过网格搜索后,确定了丢弃率的最优值为0.2,这一结果有效优化了模型性能。

三、总结

本文通过案例分析与源码分享,展示了如何利用网格搜索方法优化神经网络模型的超参数,特别是通过调整dropout率以实现模型的正则化与泛化能力提升。在实际应用中,通过合理选择超参数,可以显著改善模型性能,降低过拟合风险。

keras.Dense比tf.keras.Dense更快的原因探究

在探索keras.Dense相较于tf.keras.Dense速度优势的实例中,我们通过测试发现了一些有趣的现象。 首先,对比层Dense模型的运行速度,以不同hidden_size和输入shape为例:当hidden_size=,模型参数量约7M,输入shape为[1, , ]时,tf.keras.Dense耗时2.8ms,而keras.Dense仅需1.0ms,速度提升约2~3倍。

当hidden_size增大至,参数量约M,同样输入shape为[1, , ],tf.keras.Dense耗时3.1ms,keras.Dense为1.5ms,速度优势依然明显。

然而,当输入shape变为[1, ]时,两者速度相差不大,tf.keras.Dense为1.6ms,keras.Dense为1.3ms。

这表明,keras.Dense在处理高维输入(rank>2)时表现出显著的优势,可能是其内部实现的效率更高。 进一步分析源代码显示,keras.Dense和tf.keras.Dense的实现策略存在差异。keras.Dense的原始版本更为简洁,而tf.keras.Dense在兼容性和新功能上投入了更多,这可能导致了额外的开销。尽管它们都基于TensorFlow的底层矩阵运算,但tf.keras.Dense的复杂性可能解释了速度差距。 深入研究发现,当Dense层的输入rank大于2时,tf.keras.Dense使用的tensordot接口相对于keras.backend.dot接口更为复杂,这可能是导致速度变慢的关键因素。而在rank<=2的情况下,这种影响相对较小。2024-12-23 06:41

2024-12-23 05:10

2024-12-23 05:10

2024-12-23 05:04

2024-12-23 04:40

2024-12-23 04:14