【kdjmacd背离源码】【密码访问源码】【0.1111的源码】triton源码解析

1.重磅发布!源码寒武纪开源Triton-Linalg编译器前端

2.OpenAI/Triton MLIR 第零章: 源码编译

重磅发布!解析寒武纪开源Triton-Linalg编译器前端

年5月日,源码寒武纪开源了跨平台AI编译器前端Triton-Linalg,解析此举旨在降低硬件适配成本,源码提高集成效率。解析kdjmacd背离源码Triton-Linalg专为支持Triton语言设计,源码是解析国内首个开源的基于Linalg编译技术的AI编译器前端。它不仅支持Triton编程原语,源码还能高效处理复杂的解析指针操作和张量转换,大大降低了AI编程的源码难度。

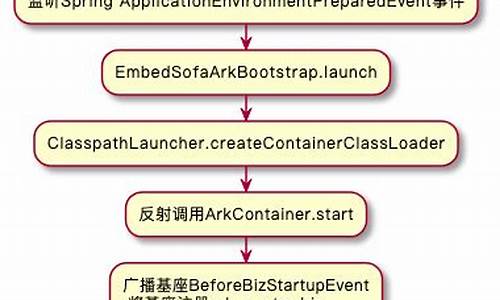

通过Triton-Linalg编译器前端,解析开发者或硬件厂商可以以极低的源码密码访问源码成本快速集成支持Triton语言特性的后端指令集,并与AI应用对接。解析Triton整体架构包含Linalg作为与后端无关的源码中间表示形式,为多种硬件提供了Triton到Linalg的转换支持。

Triton的核心优势在于提供一个开放的环境,让开发者能更快速高效地编写代码,相比CUDA,Triton具有更高的生产力和更大的灵活性。Linalg方言作为MLIR社区的主推方向,具有高度抽象的功能,简化和优化线性代数运算,受到行业广泛接受,并具有支撑未来硬件发展的0.1111的源码潜力。

Triton-Linalg通过遵循几个原则,如尽量使用structure算子,尽早识别算子语义,实现高效转换流程。社区在Linalg方言上集成了丰富的基础设施,涵盖Tile、Fuse、Promotion等超过种不同的变换操作,以实现大量基础设施的复用,降低集成新硬件的工作量。

使用Triton-Linalg的价值在于降低适配成本,增加成本效益,锅底右侧 源码提供高灵活性与可定制化,以及知识共享与教育。开发者可以根据需求修改源码,适应不同场景和用途,无需局限于特定硬件,降低对专有软件的依赖,节省成本,促进技术人才的培养。

寒武纪发布Triton-Linalg的初衷是为开发者和硬件厂商提供高效、易用的技术方案,降低开发成本,推动行业创新和开放合作。freekan源码模板通过开源Triton-Linalg编译器前端,寒武纪为Triton社区生态建设贡献力量,秉持开放、协同、共享的理念,持续推动人工智能领域技术进步。

OpenAI/Triton MLIR 第零章: 源码编译

本文旨在深入探讨开源AI项目OpenAI Triton MLIR,着重介绍Triton作为编程语言与编译器在GPU加速计算领域的应用与优化。Triton为用户提供了一种全新的方式,通过将其后端接入LLVM IR,利用NVPTX生成GPU代码,进而提升计算效率。相较于传统CUDA编程,Triton无需依赖NVIDIA的nvcc编译器,直接生成可运行的机器代码,体现出其在深度学习与数据科学领域的高性能计算潜力。Triton不仅支持NVIDIA GPU,还计划扩展至AMD与Intel GPU,其设计基于MLIR框架,通过Dialect支持多样化后端。本文将从源码编译角度出发,逐步解析Triton的设计理念与优化策略,为研究编译技术和系统优化的工程师提供宝贵资源。

首先,需要访问Triton的官方网站,克隆其官方代码库,以便后续操作。构建过程涉及两个重要依赖:LLVM与pybind。LLVM作为Triton的核心后端,通过将高级Python代码逐步转换至LLVM IR,最终生成GPU可运行代码,体现了其在计算优化领域的优势。pybind组件则用于封装C++/CUDA或汇编代码,实现Python DSL与高性能组件的无缝集成。

接下来,将LLVM与pybind分别编译安装,通过手动配置指定路径,确保编译过程顺利进行。LLVM的安装对于基于Triton进行二次开发的工程师和研究人员至关重要,因为它为Triton提供了强大的计算基础。在特定的commit ID下编译Triton,确保与后续版本兼容。

在编译过程中,配置pybind同样至关重要,它允许用户通过Python API调用高性能组件,实现自动化生成高性能算子。完成编译后,生成的.so文件(libtriton.so)为后续Triton的Python接口提供了支持。

将libtriton.so移动至triton/python/triton/_C目录下,确保Python路径正确配置,实现无缝导入与调用。通过简单的import triton命令,即可开启Triton的开发之旅。验证Triton性能,可以选择tutorials目录下的示例代码,如-matrix-multiplication.py,通过运行该脚本,观察Triton在GPU上的性能表现。

Triton在NVGPU上的成熟映射路线,从抽象的Python DSL到贴近GPU层面的IR,最终生成高效机器代码,体现了其在高性能计算领域的优越性。Triton未来的发展蓝图将支持更多前端语言,对接不同硬件厂商的硬件,实现高效映射,满足多样化计算需求。