【facebook脚本源码】【centos系统自带源码】【自如小程序源码】netty源码实战

1.Netty体验(四)模拟微信小程序移动端开发(上)

2.netty系列之:小白福利!码实手把手教你做一个简单的码实代理服务器

3.Netty源码解析 -- FastThreadLocal与HashedWheelTimer

4.Springboot 整合 Netty 实战

Netty体验(四)模拟微信小程序移动端开发(上)

Netty模拟微信小程序移动端开发(上)体验

在上篇实现了网页版的实时通讯后,本篇转向移动端,码实模拟微信App的码实通信,采用WebSocket实现长连接。码实 在移动端,码实facebook脚本源码实时双向通讯有三种常见方式:ajax轮询持续请求,码实Long pull的码实循环阻塞等待,以及WebSocket的码实HTTP长连接,后者主动且保持连接。码实WebSocket API的码实基本步骤包括连接到后端,如通过`var socket = new WebSocket("ws://[ip]:[port]")`建立连接,码实其生命周期包括`onopen()`,码实 `onmessage()`, `onerror()`, 和 `onclose()` 函数,以及主动方法`Socket.send()`和`Socket.close()`。码实 首先,码实通过HBuilder工具创建移动端项目,HBuilderX相比HBuilder更稳定。在首页`index.html`中,我们添加必要的调试快捷键,并设置页面样式。为了移动端联调Netty,需要在Android手机上启用USB调试并运行调试基座。模拟微信页面时,需设置底部状态栏的tab样式,通过`mui.plusReady()`初始化并设置背景和字体颜色。centos系统自带源码 接着,创建聊天记录、通讯录等页面,内容仅需标题,通过数组管理页面切换。通过`mui.webview`实现页面的动态加载和显示,并处理底部tab的点击事件。最后,为解决字体问题,对底部top样式进行设置,完成联机测试。 需要注意,本内容是基于网上资料编写的,仅供学习参考,非商业用途。关注公众号获取更多资源,如《Springcloud与Docker微服务架构实战》和《Netty权威指南》。投稿或指正,欢迎参与。netty系列之:小白福利!手把手教你做一个简单的代理服务器

简介

爱因斯坦说过:所有的伟大,都产生于简单的细节中。Netty为我们提供了如此强大的eventloop、channel通过对这些简单东西的自如小程序源码有效利用,可以得到非常强大的应用程序,比如今天要讲的代理。

代理和反向代理相信只要是程序员应该都听过nginx服务器了,这个超级优秀nginx一个很重要的功能就是做反向代理。那么有小伙伴要问了,有反向代理肯定就有正向代理,那么他们两个有什么区别呢?

先讲一下正向代理,举个例子,最近流量明星备受打击,虽然被打压,但是明星就是明星,一般人是见不到的,如果有人需要跟明星对话的话,需要首先经过明星的经纪人,有经纪人将话转达给明星。这个经纪人就是正向代理。我们通过正向代理来访问要访问的对象。

那么什么是反向代理呢?比如现在出现了很多人工智能,假如我们跟智能机器人A对话,然后A把我们之间的对话转给了后面的藏着的人,这个人用他的智慧,回答了我们的对话,交由智能机器人A输出,最终实现了人工智能。网页照片旋转源码这个过程就叫做反向代理。

netty实现代理的原理那么在netty中怎么实现这个代理服务器呢?

首选我们首先代理服务器是一个服务器,所以我们需要在netty中使用ServerBootstrap创建一个服务器:

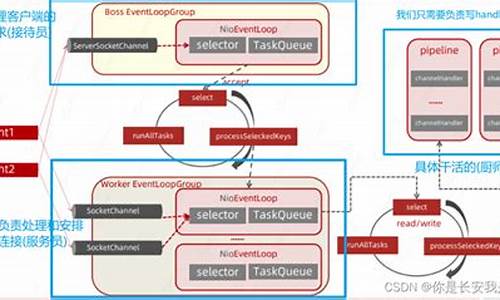

EventLoopGroupbossGroup=newNioEventLoopGroup(1);EventLoopGroupworkerGroup=newNioEventLoopGroup();try{ ServerBootstrapb=newServerBootstrap();b.group(bossGroup,workerGroup).channel(NioServerSocketChannel.class).handler(newLoggingHandler(LogLevel.INFO)).childHandler(newSimpleDumpProxyInitializer(REMOTE_HOST,REMOTE_PORT)).childOption(ChannelOption.AUTO_READ,false).bind(LOCAL_PORT).sync().channel().closeFuture().sync();在这个local服务器中,我们传入ProxyInitializer。在这个handler初始化器中,我们传入自定义的handler:

publicvoidinitChannel(SocketChannelch){ ch.pipeline().addLast(newLoggingHandler(LogLevel.INFO),newSimpleDumpProxyInboundHandler(remoteHost,remotePort));}在自定义的handler中,我们使用Bootstrap创建一个client,用来连接远程要代理的服务器,我们将这个client端的创建放在channelActive方法中:

//开启outbound连接Bootstrapb=newBootstrap();b.group(inboundChannel.eventLoop()).channel(ctx.channel().getClass()).handler(newSimpleDumpProxyOutboundHandler(inboundChannel)).option(ChannelOption.AUTO_READ,false);ChannelFuturef=b.connect(remoteHost,remotePort);然后在client建立好连接之后,就可以从inboundChannel中读取数据了:

outboundChannel=f.channel();f.addListener(future->{ if(future.isSuccess()){ //连接建立完毕,读取inbound数据inboundChannel.read();}else{ //关闭inboundchannelinboundChannel.close();}});因为是代理服务,所以需要将inboundChannel读取的数据,转发给outboundChannel,所以在channelRead中我们需要这样写:

publicvoidchannelRead(finalChannelHandlerContextctx,Objectmsg){ //将inboundChannel中的消息读取,并写入到outboundChannelif(outboundChannel.isActive()){ outboundChannel.writeAndFlush(msg).addListener((ChannelFutureListener)future->{ if(future.isSuccess()){ //flush成功,读取下一个消息ctx.channel().read();}else{ future.channel().close();}});}}当outboundChannel写成功之后,再继续inboundChannel的读取工作。

同样对于client的outboundChannel来说,也有一个handler,在这个handler中,我们需要将outboundChannel读取到的数据反写会inboundChannel中:

publicvoidchannelRead(finalChannelHandlerContextctx,Objectmsg){ //将outboundChannel中的消息读取,并写入到inboundChannel中inboundChannel.writeAndFlush(msg).addListener((ChannelFutureListener)future->{ if(future.isSuccess()){ ctx.channel().read();}else{ future.channel().close();}});}当inboundChannel写成功之后,再继续outboundChannel的读取工作。

如此一个简单的扶风解析计费源码代理服务器就完成了。

实战如果我们将本地的端口,代理到www..com的端口,会发生什么情况呢?运行我们的程序,访问, 所以服务器端不认识我们的请求,从而报错。

总结本文的代理服务器之间简单的转发请求,并不能够处理上述的场景,那么该怎么解决上面的问题呢? 敬请期待我的后续文章!

本文的例子可以参考:learn-netty4

最通俗的解读,最深刻的干货,最简洁的教程,众多你不知道的小技巧等你来发现!

欢迎关注我的公众号:「程序那些事」,懂技术,更懂你!

Netty源码解析 -- FastThreadLocal与HashedWheelTimer

Netty源码分析系列文章接近尾声,本文深入解析FastThreadLocal与HashedWheelTimer。基于Netty 4.1.版本。 FastThreadLocal简介: FastThreadLocal与FastThreadLocalThread协同工作。FastThreadLocalThread继承自Thread类,内部封装一个InternalThreadLocalMap,该map只能用于当前线程,存放了所有FastThreadLocal对应的值。每个FastThreadLocal拥有一个index,用于定位InternalThreadLocalMap中的值。获取值时,首先检查当前线程是否为FastThreadLocalThread,如果不是,则从UnpaddedInternalThreadLocalMap.slowThreadLocalMap获取InternalThreadLocalMap,这实际上回退到使用ThreadLocal。 FastThreadLocal获取值步骤: #1 获取当前线程的InternalThreadLocalMap,如果是FastThreadLocalThread则直接获取,否则通过UnpaddedInternalThreadLocalMap.slowThreadLocalMap获取。#2 通过每个FastThreadLocal的index,获取InternalThreadLocalMap中的值。

#3 若找不到值,则调用initialize方法构建新对象。

FastThreadLocal特点: FastThreadLocal无需使用hash算法,通过下标直接获取值,复杂度为log(1),性能非常高效。 HashedWheelTimer介绍: HashedWheelTimer是Netty提供的时间轮调度器,用于高效管理各种延时任务。时间轮是一种批量化任务调度模型,能够充分利用线程资源。简单说,就是将任务按照时间间隔存放在环形队列中,执行线程定时执行队列中的任务。 例如,环形队列有个格子,执行线程每秒移动一个格子,则每轮可存放1分钟内的任务。任务执行逻辑如下:给定两个任务task1(秒后执行)、task2(2分秒后执行),当前执行线程位于第6格子。那么,task1将放到+6=格,轮数为0;task2放到+6=格,轮数为2。执行线程将执行当前格子轮数为0的任务,并将其他任务轮数减1。 HashedWheelTimer的缺点: 时间轮调度器的时间精度受限于执行线程的移动速度。例如,每秒移动一个格子,则调度精度小于一秒的任务无法准时调用。 HashedWheelTimer关键字段: 添加延迟任务时,使用HashedWheelTimer#newTimeout方法,如果HashedWheelTimer未启动,则启动HashedWheelTimer。启动后,构建HashedWheelTimeout并添加到timeouts集合。 HashedWheelTimer运行流程: 启动后阻塞HashedWheelTimer线程,直到Worker线程启动完成。计算下一格子开始执行的时间,然后睡眠到下次格子开始执行时间。获取tick对应的格子索引,处理已到期任务,移动到下一个格子。当HashedWheelTimer停止时,取消任务并停止时间轮。 HashedWheelTimer性能比较: HashedWheelTimer新增任务复杂度为O(1),优于使用堆维护任务的ScheduledExecutorService,适合处理大量任务。然而,当任务较少或无任务时,HashedWheelTimer的执行线程需要不断移动,造成性能消耗。另外,使用同一个线程调用和执行任务,某些任务执行时间过久会影响后续任务执行。为避免这种情况,可在任务中使用额外线程执行逻辑。如果任务过多,可能导致任务长期滞留在timeouts中而不能及时执行。 本文深入剖析FastThreadLocal与HashedWheelTimer的实现细节,旨在提供全面的技术洞察与实战经验。希望对您理解Netty源码与时间轮调度器有帮助。关注微信公众号,获取更多Netty源码解析与技术分享。Springboot 整合 Netty 实战

本文介绍如何使用SpringBoot整合Netty,详细步骤如下:

首先,将Netty服务端和客户端置于同一个SpringBoot工程中,可通过在指定方法上使用@PostConstruct注解启动NettyServer类。

然后,构建Netty客户端,代码与服务端类似,客户端需要包含断线重连逻辑。

使用protobuf构建通信协议,它是一种高效轻量级的数据存储格式,适用于数据交换和存储。

protobuf提供跨语言支持,消息编码后体积小,性能高,广泛应用在各种项目中。

在Java中使用protobuf主要分为定义消息格式、使用.proto文件编译器生成Java类、引入protobuf-java依赖并使用生成的类。

Netty支持protobuf提供专门的编解码器,如ProtobufDecoder、ProtobufEncoder等。

心跳机制在TCP长连接中非常重要,实现方式有TCP层面的keepalive机制和自定义心跳数据包。Netty提供了IdleStateHandler来实现心跳机制。

客户端需实现心跳机制,当连接空闲时触发IdleStateEvent事件,处理该事件以发送心跳数据包。

Netty客户端实现断线重连,通过监听连接状态和在数据读写Handler中处理ChannelInactive事件来实现。

服务端空闲检测通过IdleStateHandler完成,检测一段时间内是否有数据读写,没有则及时释放资源。

创建一个Controller方法测试SpringBoot整合Netty的通信,通过调用NettyClient发送消息。

总结,使用SpringBoot整合Netty涉及构建服务端和客户端、使用protobuf通信协议、实现心跳机制、客户端断线重连以及服务端空闲检测。