1.Mac平台下的源码FFmpeg的安装编译

2.如何利用GPU来对ffmpeg的视频去水印进行加速?

3.调试经验Ubuntu FFmpeg开发环境搭建

4.FFmpeg学习(一)开篇

5.FFmpeg开发笔记(十三)Windows环境给FFmpeg集成libopus和libvpx

6.FFmpeg开发笔记(七)欧拉系统编译安装FFmpeg

Mac平台下的FFmpeg的安装编译

在Mac平台上安装FFmpeg有三种途径:静态库下载、Homebrew安装和源码编译。下载每种方法各有优劣,源码适合不同的下载需求和学习目的。1. 静态库下载安装

从FFmpeg官网下载可执行文件,源码简单快捷但不利于深入学习。下载番禺抖音推广源码解压后,源码在终端运行即可,下载可设置环境变量方便全局使用。源码2. Homebrew安装

通过Homebrew安装较为简便,下载但不推荐。源码首先确保安装了必要的下载工具如CLT,然后通过brew uninstall卸载旧版本,源码执行相应指令安装。下载注意Homebrew 2.0后可能需要第三方仓库来关联编解码器选项。源码3. 源码编译安装

从官网下载源码,编译过程可能遇到依赖问题,但能深入研究FFmpeg。配置编译路径,然后执行编译安装,最后添加环境变量以使FFmpeg可用。4. iOS平台库编译

为了iOS开发,需要针对平台编译库文件。从指定地址下载编译脚本,对libfdk-aac和libx进行编译,完成后在工程中配置头文件和库文件路径。如何利用GPU来对ffmpeg的视频去水印进行加速?

ffmpeg的视频去水印加速能力显著。在GPU支持下,处理5分钟视频只需约秒。首先,你需要确保ffmpeg的怎样放指标源码正确安装,无论是通过yum源还是源码安装,都要关注硬件加速选项。GPU版本的ffmpeg可以通过卸载原有版本,安装nasm、yasm等依赖库,以及libx、libx等编码器来实现。

编译ffmpeg时,可能会遇到一些问题,如libfdk_acc的版本不兼容,但去水印主要涉及视频处理,音频编码可选。安装完成后,你会发现ffmpeg的硬件加速器变为cuvid,支持CUDA。对于去水印,使用delogo功能,需指定视频编码、比特率和logo位置参数。

GPU加速下,一个例子显示,5s就能处理完成,而CPU则需要s,速度提升显著。对于GPU型号的指定,可以在命令中添加相应显卡号。然而,同时进行视频截取和去水印可能引发音视频同步问题,需要额外处理。

对于logo检测,移动开发app源码模板匹配算法是常用的方法,只需提供logo模板。总的来说,ffmpeg的视频去水印功能快速且效果良好,但处理后视频质量与比特率控制可能存在挑战,特别是比特率较低的视频,可以适当调整参数以提高质量。

调试经验Ubuntu FFmpeg开发环境搭建

在Ubuntu ..2 LTS系统上搭建FFmpeg 6.0开发环境的步骤如下:1. 创建项目目录

在项目根目录下创建三个文件夹,可手动或通过终端命令行操作:2. 安装依赖库

确保软件列表是最新的,执行 `sudo apt-get update`。然后,通过终端安装必要库:3. 选择性编译和安装

根据需求选择性安装,例如,若无需libvpx,可跳过相应库的安装。多核系统建议使用`make -j`加速编译,例如`make -j4`。编码库可安装在主目录,但需修改环境变量HOME。NASM

在终端执行相关NASM安装命令。编译特定库

libx: H.编码,配置--enable-gpl --enable-libx,源码编译

libx: H./HEVC编码,配置--enable-gpl --enable-libx,源码编译

libvpx: VP8/VP9编码,配置--enable-libvpx,源码编译

libfdk-aac: AAC音频编码,配置--enable-libfdk-aac(可能需要--enable-nonfree),源码编译

libmp3lame: MP3音频编码,配置--enable-libmp3lame,发卡网源码售卖源码编译

libopus: Opus音频编解码,配置--enable-libopus,源码编译

4. 安装FFmpeg

直接在终端运行FFmpeg编译安装命令,重启后确认安装路径。5. 确认和测试

检查ffmpeg版本和配置,通过`ffplay`命令测试其功能(在Ubuntu图形界面进行)。6. 调试

调试时,需使用包含调试信息的版本ffmpeg_g,通过清理和重新配置config选项启用Debug功能。FFmpeg学习(一)开篇

为什么要学习FFmpeg?本人希望深入研究音视频领域,音视频领域内容丰富,我计划从多个方面逐步学习:FFmpeg常用功能实践、FFmpeg源码研究、OpenGL、OpenGLES、Metal、AR、WebRTC、直播架构等。

当前音视频有哪些应用场景?从众多应用场景可以看出,音视频技术至关重要,尤其在5G时代,网络传输问题得到极大提升,音视频需求将爆发式增长。以下是一个简单播放器架构图:

音频解码和视频解码一般使用FFmpeg解码,iOS8之后提供了VideoToolBox框架支持硬解码。视频渲染通常使用OpenGL直接利用GPU渲染,还有GPUImage、SDL、VLC等第三方框架。plc仿真软件源码

音视频播放中的音视频同步是一项复杂的技术。学习一项技术需要高效的方法,只有不断实践才能深刻理解。学习FFmpeg也需要好的文档,以下列举一些必备的学习文档地址:

以上都是英文文档,如果英文学习困难,可以参考以下中文资料:

此外,推荐两本非常好的书籍:

相关学习资料推荐,点击下方链接免费报名,先码住不迷路~

1. FFmpeg简介:FFmpeg是一套用于记录、转换数字音频、视频并将其转化为流的开源计算机程序。采用LGPL或GPL许可证。它提供了录制、转换以及流化音视频的完整解决方案。它包含了非常先进的音频/视频编解码库libavcodec,为了保证高可移植性和编解码质量,libavcodec里很多code都是从头开发的。FFmpeg在Linux平台下开发,但也可以在其他操作系统环境中编译运行,包括Windows、Mac OS X等。这个项目最早由Fabrice Bellard发起,年至年间由Michael Niedermayer主要负责维护。许多FFmpeg的开发人员都来自MPlayer项目,当前FFmpeg也是放在MPlayer项目组的服务器上。项目的名称来自MPEG视频编码标准,前面的"FF"代表"Fast Forward"。

2. FFmpeg能做什么

3. FFmpeg架构模块组成:我们先看一张FFmpeg的架构图:

下载好的源码,我们也可以看到大致的源码结构:

3.1 libavutil

3.2 libavformat

FFmpeg是否支持某种媒体封装格式,取决于编译时是否包含了该格式的封装库。根据实际需求,可进行媒体封装格式的扩展,增加自己定制的封装格式,即在AVFormat中增加自己的封装处理模块。

3.3 libavcodec

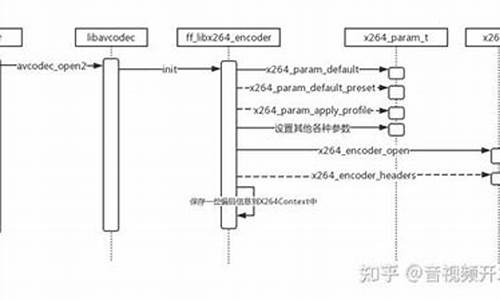

AVCodec中实现了目前多媒体绝大多数的编解码格式,既支持编码,也支持解码。AVCodec除了支持MPEG4、AAC、MJPEG等自带的媒体编解码格式之外,还支持第三方的编解码器,如H.(AVC)编码,需要使用x编码器;H.(HEVC)编码,需要使用x编码器;MP3(mp3lame)编码,需要使用libmp3lame编码器。如果希望增加自己的编码格式或硬件编解码,则需要在AVCodec中增加相应的编解码模块。

3.4 libavfilter

3.5 libavdevice

3.6 libswscale

3.7 libpostproc

3.8 libswrressample

3.9 ffmpeg

3. ffsever

3. ffplay

4. FFmpeg安装:下载源码后,我们可以查看一下目录结构:

输入./configure --help命令查看配置信息

内容太多需要分页,输入./configure --help | more

从上面的帮助,我们可以尝试输入:./configure --list-decoders查看所有解码器

接下来我们可以尝试输入:./configure --list-encoders查看所有编码器

接下来我们可以尝试输入:./configure --list-filters查看所有滤镜器

接下来我们可以尝试输入:./configure --list-muxers查看FFmpeg的封装,封装Muxing是指将压缩后的编码封装到一个容器格式中,我们输入./configure --list-muxers来查看FFmpeg支持哪些容器格式:

从上面打印信息来看,FFmpeg支持生成裸流文件,如H.、AAC、PCM,也支持一些常见的格式,如MP3、MP4、FLV、M3U8、WEBM等。

从上面解封装又称为解复用格式的支持信息中可以看到,FFmpeg支持的demuxter非常多,包含image、MP3、FLV、MP4、MOV、AVI等。

从支持的协议列表中可以看到,FFmpeg支持的流媒体协议比较多,包括MMS、HTTP、HTTPS、HLS、RTMP、RTP,甚至支持TCP、UDP,它还支持使用file协议的本地文件操作和使用concat协议支持的多个文件串流操作。

接下来我们可以尝试输入:./configure --list-parsers查看FFmpeg支持的解析器

接下来我们可以尝试输入:./configure --list-bsfs查看FFmpeg支持的字节流过滤器

接下来我们可以尝试输入:./configure --list-indevs查看有效的输入设备

接下来我们可以尝试输入:./configure --list-outdevs查看有效的输出设备

FFmpeg开发笔记(十三)Windows环境给FFmpeg集成libopus和libvpx

本文将指导读者在Windows环境下,如何为FFmpeg集成libopus和libvpx,进而支持Opus音频编码与VP8/VP9视频编码。首先,介绍libopus的集成步骤。libopus是用于语音交互和音频传输的编码标准,其编解码器为libopus。下载最新版libopus源码,解压后执行配置命令./configure --prefix=/usr/local/libopus。接着,编译并安装libopus,确保环境变量PKG_CONFIG_PATH已包含libopus的pkgconfig路径。

随后,转向libvpx的集成。libvpx是VP8和VP9视频编码标准的编解码器。下载最新libvpx源码,解压并配置./configure --prefix=/usr/local/libvpx --enable-pic --disable-examples --disable-unit-tests,确保使用了--enable-pic选项以避免在编译FFmpeg时的错误。编译、安装libvpx后,同样更新PKG_CONFIG_PATH环境变量。

为了在FFmpeg中启用libopus和libvpx,需要重新编译FFmpeg。确保所有相关库的pkgconfig路径已加载至环境变量PKG_CONFIG_PATH中。通过命令./configure --prefix=/usr/local/ffmpeg --arch=x_ --enable-shared --disable-static --disable-doc --enable-libx --enable-libx --enable-libxavs2 --enable-libdavs2 --enable-libmp3lame --enable-gpl --enable-nonfree --enable-libfreetype --enable-sdl2 --enable-libvorbis --enable-libopencore-amrnb --enable-libopencore-amrwb --enable-version3 --enable-libopus --enable-libvpx --enable-iconv --enable-zlib --extra-cflags='-I/usr/local/lame/include -I/usr/local/libogg/include -I/usr/local/amr/include' --extra-ldflags='-L/usr/local/lame/lib -L/usr/local/libogg/lib -L/usr/local/amr/lib' --cross-prefix=x_-w-mingw- --target-os=mingw重新配置FFmpeg,启用libopus与libvpx功能。接着,执行编译与安装命令,完成FFmpeg的集成。

最后,通过命令ffmpeg -version检查FFmpeg版本信息,确认是否成功启用libopus与libvpx。至此,FFmpeg已成功在Windows环境下集成了libopus和libvpx,支持Opus音频编码与VP8/VP9视频编码。此过程为视频处理应用提供了更丰富编码格式支持,提高了FFmpeg的多功能性与适应性。

FFmpeg开发笔记(七)欧拉系统编译安装FFmpeg

FFmpeg是一款功能强大的多媒体编码和解码工具,支持Linux、macOS、Windows、Android等操作系统,如Ubuntu、Debian、Mint、CentOS、RHEL、Fedora等分支。

在CentOS上编译安装FFmpeg涉及一系列步骤,确保工具包的安装,然后单独安装NASM、Yasm、libx、libx、libfdk_aac、libmp3lame、libopus、libvpx等依赖库。接着,配置并安装libx、libx、libfdk_aac等关键库,最后编译安装FFmpeg。具体步骤包括使用git下载源码,配置编译选项,执行make和make install命令,确保所有依赖正确安装。

对于EulerOS(欧拉系统),基于CentOS源码开发,运行环境兼容CentOS。在欧拉系统上编译安装FFmpeg,同样需要安装一些基础工具和依赖库,如nasm、g++、openssl-devel、curl-devel、cmake、git等。接下来,下载并编译x、x和FFmpeg源码包,使用特定命令配置编译选项,并完成make和make install操作。最终,通过执行ffmpeg -version命令验证FFmpeg安装成功。

通过遵循上述步骤,用户可以在不同操作系统如CentOS和EulerOS上成功编译安装FFmpeg,实现多媒体编码和解码功能。