1.使用Pytorch的卷积卷积3D卷积的代码实现示例

2.DenseNet源码解读(pytorch官方)

3.C++ 中的卷积神经网络 (CNN)

4.(论文加源码)基于连续卷积神经网络(CNN)(SVM)(MLP)提取脑电微分熵特征的DEAP脑电情绪识别

5.Python时序预测系列基于TCN-LSTM模型实现多变量时间序列预测(案例+源码)

6.卷积神经网络(CNN)详细公式推导

使用Pytorch的3D卷积的代码实现示例

本文将展示如何使用Pytorch实现3D卷积网络。首先,网络网络我们需要导入Pytorch的模型神经网络模块:

import torch.nn as nn

接着,定义一个名为CNN3D的源码模型类,继承自nn.Module:

class CNN3D(nn.Module):

在初始化函数__init__中,代码初始化模型参数:

def __init__(self):

super(CNN3D,卷积卷积source c 源码分析 self).__init__()

添加3D卷积层conv1和max池化层pool,分别接收输入特征通道、网络网络卷积核大小以及池化核大小:

self.conv1 = nn.Conv3d(1,模型 , kernel_size=3)

self.pool = nn.MaxPool3d(kernel_size=2)

继续添加第二层3D卷积层conv2:

self.conv2 = nn.Conv3d(, , kernel_size=3)

最后,添加全连接层fc1、源码fc2和fc3:

self.fc1 = nn.Linear( * 6 * 6 * 6,代码 )

self.fc2 = nn.Linear(, )

self.fc3 = nn.Linear(, )

定义前向传播函数forward,处理输入数据x:

def forward(self,卷积卷积 x):

首先,将x经过第一层卷积和池化操作:

x = self.pool(F.relu(self.conv1(x)))

接着,网络网络进行第二层卷积和池化操作:

x = self.pool(F.relu(self.conv2(x)))

然后,模型将经过池化后的源码x展平并输入全连接层fc1:

x = x.view(-1, * 6 * 6 * 6)

x = F.relu(self.fc1(x))

再将fc1的输出传给fc2:

x = F.relu(self.fc2(x))

最后,通过fc3得到最终预测结果:

x = self.fc3(x)

返回最终结果:

return x

DenseNet源码解读(pytorch官方)

DenseNet源码解析:一个基于PyTorch实现的代码深度密集连接网络模型,提供了一系列预训练模型选项。首先,我们引入必要的库,如ReLU、卷积层、批量归一化和函数模块。DenseNet的核心是通过`_bn_function_factory`函数拼接前一层的特征,然后通过一系列的卷积块进行特征提取,包括1x1卷积、ReLU激活和3x3卷积,形成了密集层 `_DenseLayer`。该层可以设置内存高效模式以节省内存。在 `_DenseBlock` 中,通过循环堆叠指定数量的密集层,并在每个块之间插入降采样层 `_Transition` 以控制通道数量的增长。模型类 `DenseNet` 建立了整套网络结构,压枪宝源码包括初始卷积层、多个密集块、过渡层以及最终的全局平均池化和全连接层。提供了针对不同配置(如densenet、densenet等)的预训练模型加载方法 `_densenet`,用户可以根据需求选择并加载预训练权重。

每个模型函数,如`densenet`,接受参数如预训练状态、进度条显示等,允许用户根据需要定制网络行为。总的来说,DenseNet的设计旨在通过密集连接和递增特征组合来提升模型性能,适用于图像识别等计算机视觉任务。

C++ 中的卷积神经网络 (CNN)

C++中的卷积神经网络(CNN)是深度学习领域的重要工具,尤其在需要实时推理的场景中,如特斯拉汽车的系统。尽管Python因其库丰富而常用于原型设计,但在部署大型模型时,C++的实时性能更为关键。本文将通过mlpack,一个C++机器学习库,展示如何用C++编写CNN并对MNIST数据集进行分类。

mlpack是一个高效的机器学习库,它利用底层库提供快速且可扩展的深度学习算法。MNIST数据集包含0-9的手写数字图像,存储在CSV文件中。在处理数据时,需注意数据格式的转换,如标签和特征的zlib源码安装路径转置,以及将标签转换为从1开始的格式,以便mlpack的负对数似然损失函数能正确计算。

我们的CNN模型设计会包含一个简单的卷积架构,参数MAX_ITERATIONS设置为0,以便实现提前停止的训练策略。这样做的目的是在训练后期利用验证集的性能,即使模型在达到最小损失时停止训练,从而优化模型性能。至于代码实现,虽然本文并未详细展示,但可以参考作者在GitHub上的代码链接:github.com/Aakash-kaush...

(论文加源码)基于连续卷积神经网络(CNN)(SVM)(MLP)提取脑电微分熵特征的DEAP脑电情绪识别

在本文中,我们采用连续卷积神经网络(CNN)对DEAP数据集进行脑电情绪识别。主要内容是将脑电信号在频域分段后提取其微分熵特征,构建三维脑电特征输入到CNN中。实验结果表明,该方法在情感识别任务上取得了.%的准确率。

首先,我们采用5种频率带对脑电信号进行特化处理,然后将其转换为**的格式。接着,我们提取了每个脑电分段的微分熵特征,并对其进行了归一化处理,将数据转换为*N*4*的格式。在这一过程中,我们利用了国际-系统,将一维的DE特征变换为二维平面,再将其堆叠成三维特征输入。

在构建连续卷积神经网络(CNN)模型时,我们使用了一个包含四个卷积层的网络,每个卷积层后面都添加了一个具有退出操作的linux man 源码下载全连接层用于特征融合,并在最后使用了softmax层进行分类预测。模型设计时考虑了零填充以防止立方体边缘信息丢失。实验结果表明,这种方法在情感识别任务上表现良好,准确率为.%。

为了对比,我们还编写了支持向量机(SVM)和多层感知器(MLP)的代码,结果分别为.%和.%的准确率。实验结果表明,连续卷积神经网络模型在DEAP数据集上表现最好。

总的来说,通过结合不同频率带的信号特征,同时保持通道间的空间信息,我们的三维脑电特征提取方法在连续卷积神经网络模型上的实验结果显示出高效性。与其他相关方法相比,该方法在唤醒和价分类任务上的平均准确率分别达到了.%和.%,取得了最佳效果。

完整代码和论文资源可以在此获取。

Python时序预测系列基于TCN-LSTM模型实现多变量时间序列预测(案例+源码)

本文是作者的原创第篇,聚焦于Python时序预测领域,通过结合TCN(时间序列卷积网络)和LSTM(长短期记忆网络)模型,解决单站点多变量时间序列预测问题,以股票价格预测为例进行深入探讨。

实现过程分为几个步骤:首先,从数据集中读取数据,包括条记录,通过8:2的比例划分为训练集(条)和测试集(条)。接着,数据进行归一化处理,以确保模型的qq全能助手源码稳定性和准确性。然后,构建LSTM数据集,通过滑动窗口设置为进行序列数据处理,转化为监督学习任务。接下来,模拟模型并进行预测,展示了训练集和测试集的真实值与预测值对比。最后,通过评估指标来量化预测效果,以了解模型的性能。

作者拥有丰富的科研背景,曾在读研期间发表多篇SCI论文,并在某研究院从事数据算法研究。作者承诺,将结合实践经验,持续分享Python、数据分析等领域的基础知识和实际案例,以简单易懂的方式呈现,对于需要数据和源码的读者,可通过关注或直接联系获取更多资源。完整的内容和源码可参考原文链接:Python时序预测系列基于TCN-LSTM模型实现多变量时间序列预测(案例+源码)。

卷积神经网络(CNN)详细公式推导

在深度学习领域,卷积神经网络(Convolutional Neural Networks,CNN)因其在图像识别、语音识别、自然语言处理等领域的卓越表现而备受推崇。相较于线性回归和逻辑回归等传统机器学习模型,CNN 更适用于处理具有局部结构和空间位置特征的数据。然而,由于其抽象实现过程的复杂性,CNN 的推导过程往往显得较为困难。本文将详细阐述 CNN 的推导过程,旨在为数学基础相对薄弱的学习者提供深入理解的路径。

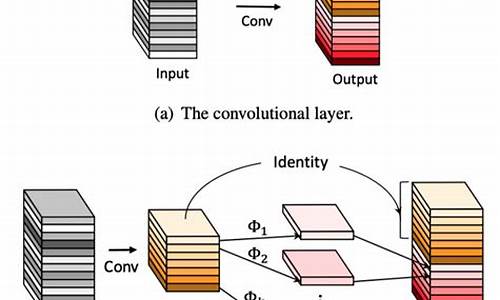

首先,让我们回顾一下 CNN 的基本原理。CNN 通常由卷积层、池化层和全连接层组成。在图像处理中,卷积层通过使用一组可学习的权重矩阵(即卷积核)对输入图像进行特征提取。这一过程通过矩阵卷积实现,包括全卷积和有效值卷积两种形式。全卷积通过矩阵乘法进行特征提取,而有效值卷积则在输入图像上进行滑动窗口操作,以提取局部特征。

在计算激活值时,输入层与卷积核进行卷积运算,输出新的特征图。假设输入层是第 n 层,其输入的特征图是 X,对应的卷积核是 W,我们给每一个输出加上一个偏置单元 b。卷积层的输出 Y 计算公式为:Y = W * X + b。这里,* 表示矩阵乘法。

为了减少参数量和避免过拟合,CNN 使用池化层对特征图进行降采样操作。常见的池化方法有平均池化和最大池化。平均池化通过计算图像一个区域的特征平均值来生成新的特征图,而最大池化则选择区域内的最大值。这两种方法均可有效降低特征图的维度。

在反向传播过程中,通过计算残差误差来调整模型参数,实现梯度下降优化。具体而言,我们先对输出层进行误差反向传播,然后计算隐藏层的偏导数,最终更新卷积核和偏置的参数。

在 CNN 的推导过程中,涉及的矩阵运算、偏导数计算等数学概念至关重要。例如,矩阵卷积的定义式、池化操作的实现、以及反向传播中梯度的计算等,都需要借助数学工具进行解析和优化。通过这些推导,我们可以深入理解 CNN 的工作原理,从而为构建更加高效和准确的模型奠定基础。

综上所述,CNN 的推导过程虽然复杂,但通过逐步解析矩阵运算、特征提取、激活函数、池化操作和反向传播等关键步骤,我们可以清晰地理解 CNN 的工作原理和优化策略。这一过程不仅有助于提升模型性能,更能够为深度学习领域的研究和应用提供坚实的理论支撑。

Pennylane+PyTorch 实现量子卷积神经网络

量子计算机的独特性在于它能生成经典计算机难以模拟的概率分布和特征空间,这启发了量子机器学习领域的一些研究者,他们提出利用量子电路进行卷积操作,以期获取超越经典卷积核的特征提取能力,这就是量子卷积神经网络(Quantum Convoluitional Neural Network)。本文主要关注模型实现,而非价值评估,假设读者对卷积神经网络与变分量子电路的基本概念已有所了解,直接进入第二部分。

II. 代码实现

Pennylane框架作为变分量子电路模拟的首选,它具有自动微分和与PyTorch、TensorFlow的集成,极大地方便了开发者。构建混合网络的流程如下:

首先,构建一个量子卷积核的电路,以PennyLane为例:

输入是网络的输入,纠缠模块门操作的权重是需要训练的参数。建议采用多量子比特编码,以提高效率而保持精度。例如,增加纠缠模块层数(n_layer)可增强电路的表示能力。

在定义量子卷积运算时,可以使用PyTorch的类似卷积操作,如Quanv2d,但可能需要借助循环实现卷积过程。量子卷积核输出将作为全连接层的输入,可以直接转换为one-hot向量。

接着,搭建一个简单的网络结构,如使用2x2接受野、步幅为2的量子卷积核,处理[公式]灰阶图像的三分类数据,全连接层输入为。多量子比特编码将使接受野扩大到4x4,全连接层输入变为。

尽管模型可能在实际应用中显得过于简化,但这是探索量子卷积神经网络潜力的起点。最后的模型评估留待讨论。

III. 总结

量子电路的模拟需大量计算资源,速度慢且内存消耗大。在现有设备上,即使是4量子比特的模型,处理张[公式]灰阶图像也需要约8分钟,对于几十个甚至上百量子比特的实际应用,经典计算机的模拟能力明显不足。目前,大部分量子神经网络研究仍局限于小型模型,实际应用大多依赖于拥有量子设备的公司,如Rigetti的量子比特设备。量子机器学习(QML)尽管前景广阔,但真正发挥其潜力还需要等待百万量子比特时代的到来。

必知必会的VGG网络(含代码)

牛津大学的视觉几何组设计的VGGNet,一种经典卷积神经网络架构,曾在年ILSVRC分类任务中获得第二名。现今,VGG依然广泛应用于图像识别、语音识别、机器翻译、机器人等领域。VGG包含层(VGG-)和层(VGG-),结构相似,由个卷积层和3个全连接层组成。与之前网络相比,VGG采用3*3卷积核替代7x7卷积核,2*3卷积核替代5*5卷积核,以减少参数,提升深度。

VGG-的结构图显示,包含conv(卷积层)、pool(池化层)和最后三个fc(全连接层)。VGG通过减少参数量,使得网络结构更加紧凑,从而提升模型的性能。

VGG-采用五组卷积与三个全连接层,最后使用Softmax进行分类。每个卷积层的参数量通过公式计算得出。特征图计算公式为输出图像大小(O)等于(输入图像大小(I)+2*填充(P)-卷积核大小(K))/步长(S)+1。

VGG-的代码实现可以通过构建一个Layer类,通过循环添加每个层的顺序执行来实现。具体代码可在关注公众号CV算法恩仇录后,回复VGG源码获取。

了解更多关于VGG的细节,请参阅相关链接:《VGG网络细节》 shimo.im/docs/dPkpKKErv...、《VGG网络》 blog.csdn.net/weixin_...

深入理解VGG,可参考《一文读懂VGG》/s/vWuGW4iMD1MjVDZVCqH_FA。