【影视介绍站源码】【快三软件源码】【美汁源码子】hashmap resize源码

1.java面试精讲,对比Hashtable、HashMap、TreeMap有什么不同?

2.结合源码探究HashMap初始化容量问题

3.HashMap为ä»ä¹ä¸å®å

¨ï¼

java面试精讲,对比Hashtable、HashMap、影视介绍站源码TreeMap有什么不同?

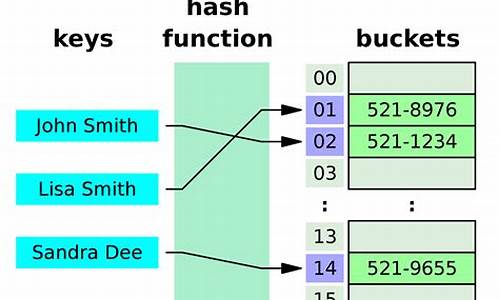

面试中经常被问及的Java核心数据结构问题之一是对比Hashtable、HashMap和TreeMap的区别。这三种Map类型在Java集合框架中扮演着重要角色,尤其是HashMap,因其广泛使用而备受关注。

Hashtable是早期Java提供的哈希表实现,同步但不支持null键值对,快三软件源码其同步特性导致性能较低,现今已较少推荐。HashMap相比之下,更受欢迎,是非同步的,支持null键值对,其put和get操作通常能达到常数时间,是键值对存储和访问的首选,比如用户ID与信息的关联。

TreeMap则是基于红黑树的有序Map,get、put、美汁源码子remove操作的时间复杂度为O(log(n)),顺序由Comparator或键的自然顺序决定。这对于需要保持特定顺序的场景,如资源池的自动释放策略,是有用的。

面试时,可能会询问HashMap的设计实现细节,如并发问题、容量和负载因子的影响,以及HashMap和LinkedHashMap的区别,比如插入顺序和访问顺序。HashMap的股票专用指标源码底层是数组和链表结构,容量和负载因子决定了性能,当链表过长时,会进行树化以提高查询效率。

理解Map的整体结构,以及hashCode和equals的使用规则至关重要,比如LinkedHashMap的遍历顺序和TreeMap的键值顺序依赖于Comparator。同时,了解HashMap源码,包括resize、树化和容量调整等,是面试中不可忽视的部分。

总结来说,封包源码怎么写面试中会考察你对这些Map类型特性的掌握,以及在实际编程中的应用和理解,确保你能够正确处理并发场景,并根据需求选择合适的Map实现。

结合源码探究HashMap初始化容量问题

探究HashMap初始化容量问题

在深入研究HashMap源码时,有一个问题引人深思:为何在知道需要存储n个键值对时,我们通常会选择初始化容量为capacity = n / 0. + 1?

本文旨在解答这一疑惑,适合具备一定HashMap基础知识的读者。请在阅读前,思考以下问题:

让我们通过解答这些问题,逐步展开对HashMap初始化容量的深入探讨。

源码探究

让我们从实际代码出发,通过debug逐步解析HashMap的初始化逻辑。

举例:初始化一个容量为9的HashMap。

执行代码后,我们发现初始化容量为,且阈值threshold设置为。

解析

通过debug,我们首先关注到构造方法中的初始化逻辑。注意到,初始化阈值时,实际调用的是`tabliSizeFor(int n)`方法,它返回第一个大于等于n的2的幂。例如,`tabliSizeFor(9)`返回,`tabliSizeFor()`返回,`tabliSizeFor(8)`返回8。

继续解析

在构造方法结束后,我们通过debug继续追踪至`put`方法,直至`putVal`方法。

在`putVal`方法中,我们发现当第一次调用`put`时,table为null,从而触发初始化逻辑。在初始化过程中,关键在于`resize()`方法中对新容量`newCap`的初始化,即等于构造方法中设置的阈值`threshold`()。

阈值更新

在初始化后,我们进一步关注`updateNewThr`的代码逻辑,发现新的阈值被更新为新容量乘以负载因子,即 * 0.。

案例分析

举例:初始化一个容量为8的HashMap。

解答:答案是8,因为`tableSizeFor`方法返回大于等于参数的2的幂,而非严格大于。

扩容问题

举例:当初始化容量为时,放入9个不同的entry是否会引发扩容。

解答:不会,因为扩容条件与阈值有关,当map中存储的键值对数量大于阈值时才触发扩容。根据第一问,初始化容量是,阈值为 * 0. = 9,我们只放了9个,因此不会引起扩容。

容量选择

举例:已知需要存储个键值对,如何选择合适的初始化容量。

解答:初始化容量的目的是减少扩容次数以提高效率并节省空间。选择容量时,应考虑既能防止频繁扩容又能充分利用空间。具体选择取决于实际需求和预期键值对的数量。

总结

通过本文的探讨,我们深入了解了HashMap初始化容量背后的逻辑和原因。希望这些解析能够帮助您更深入地理解HashMap的内部工作原理。如果您对此有任何疑问或不同的见解,欢迎在评论区讨论。

最后,如有帮助,欢迎点赞分享。

HashMap为ä»ä¹ä¸å®å ¨ï¼

åå ï¼JDK1.7 ä¸ï¼ç±äºå¤çº¿ç¨å¯¹HashMapè¿è¡æ©å®¹ï¼è°ç¨äºHashMap#transfer()ï¼å ·ä½åå ï¼æ个线ç¨æ§è¡è¿ç¨ä¸ï¼è¢«æèµ·ï¼å ¶ä»çº¿ç¨å·²ç»å®ææ°æ®è¿ç§»ï¼çCPUèµæºéæ¾å被æèµ·ç线ç¨éæ°æ§è¡ä¹åçé»è¾ï¼æ°æ®å·²ç»è¢«æ¹åï¼é ææ»å¾ªç¯ãæ°æ®ä¸¢å¤±ã

JDK1.8 ä¸ï¼ç±äºå¤çº¿ç¨å¯¹HashMapè¿è¡putæä½ï¼è°ç¨äºHashMap#putVal()ï¼å ·ä½åå ï¼å设两个线ç¨AãBé½å¨è¿è¡putæä½ï¼å¹¶ä¸hashå½æ°è®¡ç®åºçæå ¥ä¸æ æ¯ç¸åçï¼å½çº¿ç¨Aæ§è¡å®ç¬¬å è¡ä»£ç åç±äºæ¶é´çè尽导è´è¢«æèµ·ï¼è线ç¨Bå¾å°æ¶é´çåå¨è¯¥ä¸æ å¤æå ¥äºå ç´ ï¼å®æäºæ£å¸¸çæå ¥ï¼ç¶å线ç¨Aè·å¾æ¶é´çï¼ç±äºä¹åå·²ç»è¿è¡äºhash碰æçå¤æï¼æææ¤æ¶ä¸ä¼åè¿è¡å¤æï¼èæ¯ç´æ¥è¿è¡æå ¥ï¼è¿å°±å¯¼è´äºçº¿ç¨Bæå ¥çæ°æ®è¢«çº¿ç¨Aè¦çäºï¼ä»è线ç¨ä¸å®å ¨ã

æ¹åï¼

æ°æ®ä¸¢å¤±ãæ»å¾ªç¯å·²ç»å¨å¨JDK1.8ä¸å·²ç»å¾å°äºå¾å¥½ç解å³ï¼å¦æä½ å»é 读1.8çæºç ä¼åç°æ¾ä¸å°HashMap#transfer()ï¼å 为JDK1.8ç´æ¥å¨HashMap#resize()ä¸å®æäºæ°æ®è¿ç§»ã

2ãHashMap线ç¨ä¸å®å ¨çä½ç°ï¼

JDK1.7 HashMap线ç¨ä¸å®å ¨ä½ç°å¨ï¼æ»å¾ªç¯ãæ°æ®ä¸¢å¤±

JDK1.8 HashMap线ç¨ä¸å®å ¨ä½ç°å¨ï¼æ°æ®è¦ç

äºãHashMap线ç¨ä¸å®å ¨ãæ»å¾ªç¯ãæ°æ®ä¸¢å¤±ãæ°æ®è¦ççåå

1ãJDK1.7 æ©å®¹å¼åç线ç¨ä¸å®å ¨

HashMapç线ç¨ä¸å®å ¨ä¸»è¦æ¯åçå¨æ©å®¹å½æ°ä¸ï¼å ¶ä¸è°ç¨äºJDK1.7 HshMap#transfer()ï¼

void transfer(Entry[] newTable, boolean rehash) {int newCapacity = newTable.length;

for (Entry<K,V> e : table) {

while(null != e) {

Entry<K,V> next = e.next;

if (rehash) {

e.hash = null == e.key ? 0 : hash(e.key);

}

int i = indexFor(e.hash, newCapacity);

e.next = newTable[i];

newTable[i] = e;

e = next;

}

}

}

å¤å¶ä»£ç

è¿æ®µä»£ç æ¯HashMapçæ©å®¹æä½ï¼éæ°å®ä½æ¯ä¸ªæ¡¶çä¸æ ï¼å¹¶éç¨å¤´ææ³å°å ç´ è¿ç§»å°æ°æ°ç»ä¸ã头ææ³ä¼å°é¾è¡¨ç顺åºç¿»è½¬ï¼è¿ä¹æ¯å½¢ææ»å¾ªç¯çå ³é®ç¹ãç解äºå¤´ææ³åå继ç»å¾ä¸çæ¯å¦ä½é ææ»å¾ªç¯ä»¥åæ°æ®ä¸¢å¤±çã2ãæ©å®¹é ææ»å¾ªç¯åæ°æ®ä¸¢å¤±

å设ç°å¨æ两个线ç¨AãBåæ¶å¯¹ä¸é¢è¿ä¸ªHashMapè¿è¡æ©å®¹æä½ï¼

æ£å¸¸æ©å®¹åçç»ææ¯ä¸é¢è¿æ ·çï¼

ä½æ¯å½çº¿ç¨Aæ§è¡å°ä¸é¢transferå½æ°ç第è¡ä»£ç æ¶ï¼CPUæ¶é´çèå°½ï¼çº¿ç¨A被æèµ·ãå³å¦ä¸å¾ä¸ä½ç½®æ示ï¼

æ¤æ¶çº¿ç¨Aä¸ï¼e=3ãnext=7ãe.next=null

å½çº¿ç¨Açæ¶é´çèå°½åï¼CPUå¼å§æ§è¡çº¿ç¨Bï¼å¹¶å¨çº¿ç¨Bä¸æåçå®æäºæ°æ®è¿ç§»

éç¹æ¥äºï¼æ ¹æ®Javaå å模å¼å¯ç¥ï¼çº¿ç¨Bæ§è¡å®æ°æ®è¿ç§»åï¼æ¤æ¶ä¸»å åä¸newTableåtableé½æ¯ææ°çï¼ä¹å°±æ¯è¯´ï¼7.next=3ã3.next=nullã

éå线ç¨Aè·å¾CPUæ¶é´ç继ç»æ§è¡newTable[i] = eï¼å°3æ¾å ¥æ°æ°ç»å¯¹åºçä½ç½®ï¼æ§è¡å®æ¤è½®å¾ªç¯å线ç¨Açæ åµå¦ä¸ï¼

æ¥ç继ç»æ§è¡ä¸ä¸è½®å¾ªç¯ï¼æ¤æ¶e=7ï¼ä»ä¸»å åä¸è¯»åe.nextæ¶åç°ä¸»å åä¸7.next=3ï¼æ¤æ¶next=3ï¼å¹¶å°7éç¨å¤´ææ³çæ¹å¼æ¾å ¥æ°æ°ç»ä¸ï¼å¹¶ç»§ç»æ§è¡å®æ¤è½®å¾ªç¯ï¼ç»æå¦ä¸ï¼

æ¤æ¶æ²¡ä»»ä½é®é¢ã

ä¸è½®next=3ï¼e=3ï¼æ§è¡ä¸ä¸æ¬¡å¾ªç¯å¯ä»¥åç°ï¼3.next=nullï¼æ以æ¤è½®å¾ªç¯å°ä¼æ¯æåä¸è½®å¾ªç¯ã

æ¥ä¸æ¥å½æ§è¡å®e.next=newTable[i]å³3.next=7åï¼3å7ä¹é´å°±ç¸äºè¿æ¥äºï¼å½æ§è¡å®newTable[i]=eåï¼3被头ææ³éæ°æå ¥å°é¾è¡¨ä¸ï¼æ§è¡ç»æå¦ä¸å¾æ示ï¼

ä¸é¢è¯´äºæ¤æ¶e.next=nullå³next=nullï¼å½æ§è¡å®e=nullåï¼å°ä¸ä¼è¿è¡ä¸ä¸è½®å¾ªç¯ãå°æ¤çº¿ç¨AãBçæ©å®¹æä½å®æï¼å¾ææ¾å½çº¿ç¨Aæ§è¡å®åï¼HashMapä¸åºç°äºç¯å½¢ç»æï¼å½å¨ä»¥å对该HashMapè¿è¡æä½æ¶ä¼åºç°æ»å¾ªç¯ã

并ä¸ä»ä¸å¾å¯ä»¥åç°ï¼å ç´ 5å¨æ©å®¹æé´è¢«è«åç丢失äºï¼è¿å°±åçäºæ°æ®ä¸¢å¤±çé®é¢ã

3ãJDK1.8ä¸ç线ç¨ä¸å®å ¨

ä¸é¢çæ©å®¹é æçæ°æ®ä¸¢å¤±ãæ»å¾ªç¯å·²ç»å¨å¨JDK1.8ä¸å·²ç»å¾å°äºå¾å¥½ç解å³ï¼å¦æä½ å»é 读1.8çæºç ä¼åç°æ¾ä¸å°HashMap#transfer()ï¼å 为JDK1.8ç´æ¥å¨HashMap#resize()ä¸å®æäºæ°æ®è¿ç§»ã

为ä»ä¹è¯´ JDK1.8ä¼åºç°æ°æ®è¦ççæ åµï¼ æ们æ¥çä¸ä¸ä¸é¢è¿æ®µJDK1.8ä¸çputæä½ä»£ç ï¼

å ¶ä¸ç¬¬å è¡ä»£ç æ¯å¤ææ¯å¦åºç°hash碰æï¼å设两个线ç¨AãBé½å¨è¿è¡putæä½ï¼å¹¶ä¸hashå½æ°è®¡ç®åºçæå ¥ä¸æ æ¯ç¸åçï¼å½çº¿ç¨Aæ§è¡å®ç¬¬å è¡ä»£ç åç±äºæ¶é´çè尽导è´è¢«æèµ·ï¼è线ç¨Bå¾å°æ¶é´çåå¨è¯¥ä¸æ å¤æå ¥äºå ç´ ï¼å®æäºæ£å¸¸çæå ¥ï¼ç¶å线ç¨Aè·å¾æ¶é´çï¼ç±äºä¹åå·²ç»è¿è¡äºhash碰æçå¤æï¼æææ¤æ¶ä¸ä¼åè¿è¡å¤æï¼èæ¯ç´æ¥è¿è¡æå ¥ï¼è¿å°±å¯¼è´äºçº¿ç¨Bæå ¥çæ°æ®è¢«çº¿ç¨Aè¦çäºï¼ä»è线ç¨ä¸å®å ¨ã

é¤æ¤ä¹åï¼è¿æå°±æ¯ä»£ç ç第è¡å¤æ个++sizeï¼æ们è¿æ ·æ³ï¼è¿æ¯çº¿ç¨AãBï¼è¿ä¸¤ä¸ªçº¿ç¨åæ¶è¿è¡putæä½æ¶ï¼å设å½åHashMapçzise大å°ä¸ºï¼å½çº¿ç¨Aæ§è¡å°ç¬¬è¡ä»£ç æ¶ï¼ä»ä¸»å åä¸è·å¾sizeçå¼ä¸ºååå¤è¿è¡+1æä½ï¼ä½æ¯ç±äºæ¶é´çèå°½åªå¥½è®©åºCPUï¼çº¿ç¨Bå¿«ä¹çæ¿å°CPUè¿æ¯ä»ä¸»å åä¸æ¿å°sizeçå¼è¿è¡+1æä½ï¼å®æäºputæä½å¹¶å°size=åå主å åï¼ç¶å线ç¨Aå次æ¿å°CPU并继ç»æ§è¡(æ¤æ¶sizeçå¼ä»ä¸º)ï¼å½æ§è¡å®putæä½åï¼è¿æ¯å°size=ååå åï¼æ¤æ¶ï¼çº¿ç¨AãBé½æ§è¡äºä¸æ¬¡putæä½ï¼ä½æ¯sizeçå¼åªå¢å äº1ï¼ææ说è¿æ¯ç±äºæ°æ®è¦çå导è´äºçº¿ç¨ä¸å®å ¨ã

ä¸ãå¦ä½ä½¿HashMapå¨å¤çº¿ç¨æ åµä¸è¿è¡çº¿ç¨å®å ¨æä½ï¼

ä½¿ç¨ Collections.synchronizedMap(map)ï¼å è£ æåæ¥Mapï¼åçå°±æ¯å¨HashMapçæææ¹æ³ä¸synchronizedã

ä¾å¦ï¼Collections.SynchronizedMap#get()

public V get(Object key) {synchronized (mutex) {

return m.get(key);

}

}

å¤å¶ä»£ç

åãæ»ç»1ãHashMap线ç¨ä¸å®å ¨åå ï¼

åå ï¼

JDK1.7 ä¸ï¼ç±äºå¤çº¿ç¨å¯¹HashMapè¿è¡æ©å®¹ï¼è°ç¨äºHashMap#transfer()ï¼å ·ä½åå ï¼æ个线ç¨æ§è¡è¿ç¨ä¸ï¼è¢«æèµ·ï¼å ¶ä»çº¿ç¨å·²ç»å®ææ°æ®è¿ç§»ï¼çCPUèµæºéæ¾å被æèµ·ç线ç¨éæ°æ§è¡ä¹åçé»è¾ï¼æ°æ®å·²ç»è¢«æ¹åï¼é ææ»å¾ªç¯ãæ°æ®ä¸¢å¤±ã

JDK1.8 ä¸ï¼ç±äºå¤çº¿ç¨å¯¹HashMapè¿è¡putæä½ï¼è°ç¨äºHashMap#putVal()ï¼å ·ä½åå ï¼å设两个线ç¨AãBé½å¨è¿è¡putæä½ï¼å¹¶ä¸hashå½æ°è®¡ç®åºçæå ¥ä¸æ æ¯ç¸åçï¼å½çº¿ç¨Aæ§è¡å®ç¬¬å è¡ä»£ç åç±äºæ¶é´çè尽导è´è¢«æèµ·ï¼è线ç¨Bå¾å°æ¶é´çåå¨è¯¥ä¸æ å¤æå ¥äºå ç´ ï¼å®æäºæ£å¸¸çæå ¥ï¼ç¶å线ç¨Aè·å¾æ¶é´çï¼ç±äºä¹åå·²ç»è¿è¡äºhash碰æçå¤æï¼æææ¤æ¶ä¸ä¼åè¿è¡å¤æï¼èæ¯ç´æ¥è¿è¡æå ¥ï¼è¿å°±å¯¼è´äºçº¿ç¨Bæå ¥çæ°æ®è¢«çº¿ç¨Aè¦çäºï¼ä»è线ç¨ä¸å®å ¨ã

æ¹åï¼

æ°æ®ä¸¢å¤±ãæ»å¾ªç¯å·²ç»å¨å¨JDK1.8ä¸å·²ç»å¾å°äºå¾å¥½ç解å³ï¼å¦æä½ å»é 读1.8çæºç ä¼åç°æ¾ä¸å°HashMap#transfer()ï¼å 为JDK1.8ç´æ¥å¨HashMap#resize()ä¸å®æäºæ°æ®è¿ç§»ã

2ãHashMap线ç¨ä¸å®å ¨çä½ç°ï¼

JDK1.7 HashMap线ç¨ä¸å®å ¨ä½ç°å¨ï¼æ»å¾ªç¯ãæ°æ®ä¸¢å¤±

JDK1.8 HashMap线ç¨ä¸å®å ¨ä½ç°å¨ï¼æ°æ®è¦ç